日時:2010年11月20日

場所:IMAGICA東京映像センター 第2試写室

講師:村越宏之、冨里幸太郎、佐々木孝徳(株式会社IMAGICA)喜多 真一(Sony PCL)

テーマ:3D映像とサラウンドの親和性を体感する

冨里幸太郎(株式会社IMAGICA)

村越宏之(株式会社IMAGICA)

喜多 真一(Sony PCL)

佐々木孝徳(株式会社IMAGICA)

のみなさん

沢口:2010年11月のサラウンド寺子屋は3Dとサラウンド音響の親和性を体感してみようと言う企画です。3Dとサラウンド音響というのは大変ホットな話題ですが、いい環境で聴ける条件が難しくなかなか開催できませんでした。今回はIMAGICAさんのご協力で素晴らしい環境で3Dとサラウンドを体験できることができましたので、多いに楽しんで頂けると思います。それでは、宜しくお願いします。

冨里:おはようございます。IMAGICAの3D推進室の冨里と申します。まず私のほうからIMAGICAの3Dへの取り組みの概要をお話しさせて頂きます。最初に3Dに関連する市場概況です。我々は、コンテンツ、ディストリビューション流通配信、ディバイス表示上映装置というこの3つを切り口にマーケティングをしております。

コンテンツ

ご存知の通りアバターを始めとする3D映画の興行的な成功、こちらがキーとなって来年も全米で30本以上の3D映画が公開される状況になりました。国内におきましてもすでに10本以上の3D映画が公開すると決まっております。そしてスポーツ中継、あるいはコンサート、ライブといったイベントの3D制作がいま非常に活発化しております。

ディストリビューション流通配信

作ったコンテンツをお客様にお届けする、その分野におきましてやはり有料の放送局様、ならびに配信の事業者様が積極的に取り組みをされています。スカパーさんに関しましては6月に3D専門チャンネル、スカチャン3D169、こちらを開局後、連日3D番組の放送を生中継を含めて放送をされているという現状です。またパッケージソフトBlu-rayに関しても、規格がようやく決まりまして最新のBlu-ray 3Dによる高画質、高音質作品のリリースが始まったという現状です。

3Dを表示、上映する環境

やはり今3Dの立体映像を観てサラウンド音声を聴くというところで、一番良いクオリティで聴ける環境の映画館、こちらの3D対応も急速に伸び続けています。私どもの調べですが、世界でだいたい15000スクリーン位、日本国内におきましても全体3400スクリーンのうちの約15%、500スクリーン以上が3D対応になっているという現状です。そしてホームエンタテイメント部門への波及という事でも電機メーカー様各社3Dテレビを市場投入され、2010年度4月から9月の国内出荷台数が約13万台という数字が出ております。これは薄型テレビの全体に占める割合としましては1.3%という事でまだまだ少ない状況ではあるのですが徐々に普及が始まってきています。そしてテレビ以外の個人向けの、いわゆるスマートフォンや高機能携帯端末に関しても3D表示の対応が始まっているという事で色々な出口が徐々に広がってきているという現状かと思います。

IMAGICAの3D映像技術ワークフロー

コンテンツのプランニング、プリプロダクション段階から、実際の画像を生成するプロダクション段階、それを仕上げ加工するポストプロダクション段階、そしてそれを各種用途に応じたアウトプットをするという一連の行程をサポートするというところをコンセプトに色々なサービスメニューを用意しています。やはり3Dに関して、これは通常の2Dのコンテンツ制作でも変わりはないのですが、特に重要となるのが実際にプロダクションに入る前のミーティングあるいはプリビズ(3D映像絵コンテ)を使った準備段階がその後の状況を左右すると言っても過言ではないくらい大事な工程になります。この段階で経験豊冨な3Dスーパーバイザーが参加し最適なワークフローのご提案とアドバイス等を行うという態勢です。

3Dの画像を生み出す方法として、3D撮影をするか、2Dを3Dに変換するか、3DのCG空間上で立体視を作るという、大きく分けて3つの方法論があります。3D撮影については後ほど詳しく説明します。ポスプロにおいても3D対応の編集機、そして色調整、カラーグレーディング、もちろんサラウンド設備を備えたMA室も各種用意をし用途に応じたアウトプットも万全の態勢で備えております。

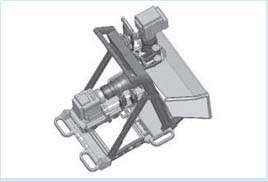

3ality DigitalTS-2撮影

IMAGICAではこの3ality DigitalのTS-2というシステムを使って、3D撮影を行っています。今日ご覧頂く映像も一部こちらを使っております。3ality Digital TS-2は立体撮影業界では画期的な特徴をもっておりまして、立体視ということでLとRの2台のカメラを取り付けて撮影をする仕組みになっていますが、この2台のカメラがきちんと同期します。これは一見当たり前のようなことに聴こえてしまうかもしれませんが、今までの立体撮影機器は非常に難しかった事が出来るようになったということで、非常に画期的なシステムと言われています。ここをしっかり同期しないと、後でご覧になる一般のお客様も目が疲れてしまう、頭が痛くなってしまうということに直結する要因となっておりますので、精度よく3D撮影をするために欠かせない要素となっております。そしてこの2台のカメラが撮影しながらリアルタイムで視差の調節が出来るというところも非常に大きな特徴の一つです。立体撮影では2台のカメラの距離と角度、これを調節していく事で奥行きと飛び出し感を作っていくのですが、この調節が撮影をしながらリアルタイムで出来るということで生中継にも十分対応可能であるという事と、従来に比べて現場でのセッティング時間が掛からないという事で、2D作品と同等の収録が実現できるという特徴を持っております。

3D作品の上映環境

今回は、HDCAM-SRテープから再生します。今日は24pのものと60iのもの両方ありますが、HDCAM-SRテープのDual streamという方式で記録された映像信号の左目の映像と右目の映像、これをVTR、Sony SRW-5800を使って再生それをBarco DP 100DLRプロジェクターを使って投影しています。立体視のために赤外線も出ているフレームシーケンシャル+液晶シャッター方式という上映仕様なのですが、実際には画像が左目、右目、左目、右目と高速で144Hz、1秒間に144コマ、左目72コマ、右目72コマという、当然人間の目では察知出来ないスピードで画が出力されています。ここでL、R、L、Rと出ている映像信号と同期する形で赤外線が発射されています。それをスクリーンから反射して皆さんのお手元のメガネ受光部分で赤外線を受光すると、出力と同期する形でメガネがL、R、L、Rとシャッターを切って右目の映像は右目だけに、左目の映像は左目だけに届けるということで立体視が成立する仕組みになっています。

通常こちらの第2試写室は、映画の場合、Dolby 3Dという3Dシステムを採用しておりデジタルシネマパッケージ、劇場用映画のデジタルシネマの規格である、DCPのファイルの再生をしています。同じく左目の映像ソースと右目の映像ソースが出てるのですけれども、Dolby 3Dの場合、INFITECという特殊な技術を使って右目左目に特殊な光を届けているという仕組みとなっております。これはRGBの光の波長を分割して左目用のRGB、右目用のRGBという分割されたものが特殊なメガネを使って見ると立体に見えます。

上映3D作品

IMAGICAからは、3本です。まず最初にGR75 オープニング映像という2分程のショートクリップを上映。

次に東京島という映画の予告編の3Dバージョンを。

最後に弦楽五重奏とピアノソロの演奏の模様を3D撮影した映像を上映します。

GR75オープニング映像これは、IMAGICA、創業75周年記念イベントを先月開催しました。この時のオープニング映像として作ったものを上映致します。この映像はあらゆる3D画像生成方法を駆使して、最新の技術をふんだんに取り入れて作った映像になっております。先ほどもワークフローの紹介で説明しましたが、3Dの撮影と、2Dから3Dへの変換、そして3DCGと色々なアプローチを取り入れて作ったものとなっております。(一同拍手)

[ 作品視聴 ]

村越:次に邦画の予告編で「東京島」という邦画の30秒トレーラーを制作しました。本編はLCRSの4チャンネルと2D映像ですが、3Dの劇場でこの予告が上映されるとのことなので、この予告編も3D&サラウンドで作りたいとの依頼がありました。みて頂ければ分かると思いますが、布というか旗を振っている部分は新たに3Dで撮影したものです。本編の音楽はステレオですが、それをサラウンドにしました。それではご覧下さい。これは、セリフはすでに収録されたものを、私がミックスしました。

[ 作品視聴 ]

村越:次に、IMAGICAの3ality Digitalで撮影した、弦楽五重奏とピアノソロを教会で収録したクリップを再生します。

制作フロー

収録は、2010年1月28日で、1日で収録しました。場所は、(東京都)品川区のグローリア・チャペルで、御殿山の品川教会と呼ばれているコンサートや録音で使われることもある場所です。IMAGICAの3DデモのためとスカパーJSATさんの素材用に共同で撮りました。撮影は、3alityDigitalカメラを使いHDCAM-SRに60i Dual Streamで撮っています。カメラは3Dカメラ1セットです。カメラが片方は正面に、もう一方は下に向いているものを、ハーフミラーを使い撮影する、3ality DigitalのTS-2と呼ばれる方式です。カメラはクレーンを使用しました。打ち合わせのときに、音は現場で録りたいとか、いやCDのプレイバックでいいと、打ち合わせでは結構バタバタしていました。私は、せっかく教会での撮影なので、サラウンド収録すると言い張っていましたが、直前までCDのプレイバックでいいよとのことでした。最終的に勝手にサラウンド収録の機材を持って行きました。当日は、プロディーサーの方にいきなり、「今日の録音はサラウンドだよね?」と言われ、「もちろんそうです。」と答えました。

手順としてまず先に音楽を収録し、アーティストの方のOKがでた後、それをプレイバックしながら撮影しました。通常のように、事前にプレイバック素材を用意するのではなく、その場で収録したものを再生しました。基本的にはクリックなどを使っていませんので1曲通してOKテークにできるようミュージシャンにお願いしました。録音の機材をどうするか悩んでいたのですが、手持ち機材でできるのか検討し、Digidesign Digi003を使い、サラウンド+弦楽五重奏なので10チャンネル必要になります。 Digi003のアナログ入力8チャンネルとADAT入力8チャンネルにHAを組み合わせることにしました。噂に聞いていた、RMEのoctamic IIをシンタックスジャパンさんから、もう一台は、Metric halo ULN-8をロックオンプロさんからレンタルしました。マイクは、サラウンドのLCRにノイマンKM 140(単一指向)LsRsにノイマンKM 131(無指向)を使い、ヴァイオリンはSennheiser MHK80、それに合うように、ヴィオラとチェロにSennheiser MKH 8040を、ピアノのオンマイクにはAKG C414B TLIIを使いました。ハンドリングが楽なようにSPL Tree(サラウンドマイクアレー)を使いました。

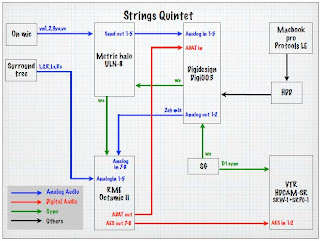

映像の撮影もあるので、同期も含めこれらをどう接続するか考えました。

[ セッティング図 ]

弦楽五重奏のオンマイクはMetric halo ULN-8を使い、SEND OUTからDigi003のアナログの入力に入っています。サラウンドツリーのマイクはRMEのOctamic IIを使い、ADAT OUTからオプティカルでDigi003に接続しています。図にSGとありますが、ビデオ撮影するのでシンクジェネレーターが必要となります。3値シンク(Tri-level Sync)をカメラに、48KHzのワードクロックをDigi003に入れて、スルーをMetric haloとRMEに送ります。最初、ワードクロックのスルーはうまくいくのだろうかと思っていましたが、実験したところノイズが出ることもなく安定してロックしていたのでこの方法を採用しました。同期に関しては、このシステム内でカメラも含めシンクしたシステムが構築できています。

Pro Toolsで編集用ステレオミックスを作り、RMEの空いている7と8チャンネルに入れ、AESアウトから、VTRに返しています。後でサラウンドの音貼りをするときのガイドや、チェック用であるとか、撮ったものをその場ですぐにプレイバックするときはにはVTRだけできるようになっています。Metric halo ULN-8はアナログしかPro Toolsに接続していないのでゲンロックしてなくてもいいように思いますが、AESで送る必要がありますので、ロックしています。なぜAES送りなのかと言うと、VTRの入り口がAESだったからです。サラウンドツリーのマイクは、すべて単一指向のマイクを使いたかったのですが、機材調達の関係で、フロントが単一指向でリアが無指向です。

次にピアノの系統ですが、基本的には同じ場所で同じように録っているので、大きくは変わっていません。何処が違うかっていうと、ピアノのオンマイクの2本、ハイとローになっています。あとの系統は全て同じです。VTRに2ミックスを送るであるとか、オンマイクの方はMetric halo ULN-8を使いサラウンドマイクの方はRME Octamic IIを使い、サウンドマイクに関しては全く同じです。

このホールは、一般的な長方形の教会で、ここIMAGICA 第2試写室より横幅は1.5倍で長さは2倍で高さは天井高4mぐらいあるような、いわゆる長方形で回りは木でステージが若干40~50cm高く上がっているというような所でした。ステージの上で録ったのですが、教会の人のアドバイスで何処で録ったら一番音がいいかだけを聴いて、ちょっとステージの前の面から下がった位置になるのですが、その位置でピアノであるとか、ミュージシャンに立って頂いて録りました。そこからサラウンドマイクは3mぐらい前のステージの面からちょっと前に出した位置、そしてステージから2m70cm上げた位置に最終的になりました。色々テストして、そこが一番サラウンド感が録れるのでそこにしました。これから4曲分を弦楽五重奏で2曲、ピアノのソロで2曲聴いて頂きます。これに関してはIMAGICAのMA室で7chミックスないしは10chミックスしています。サブウーハーは使ってません。4曲とも5.0ミックスになってます。これはスカパーさんと一緒に録ったということもあり、HD60iになっています。

[ 作品視聴 ]

ミックスについて

基本的には弦楽五重奏の方は5チャンネルのオンマイクと5チャンネルのサラウンドツリーの10チャンネルのミックスです。わかりやすく動いてる感じが欲しいというのがあったので、特に弦楽五重奏の方は右行ったり左行ったり結構はっきりしてたり、リアも結構大きめです。ピアノの方はそこまで動かないです。プロデューサーの方と方針を決めながらざっと作っておいて、微調整をしていく感じです。基本はミックスの時点ではNo EQ、No Compです。若干低域を切ってるぐらいです。それと少しだけ5.1chのリバーブの「Church」を出してます。TC Erectronic system6000の中の6.1のリバーヴのアルゴリズムを使ったものを若干加えています。ピアノの方も同じパラメーターで加えています。今回のテーマは空間を切り取るという事だったので、基本的に後処理はオンとサラウンド側の足し加減のみということで、これはもう録るときから決めていたので、その方向でミックスしました。IMAGICAからのデモは以上です。次にSony PCLの喜多さんがもってきてくれました作品について説明して頂きます。

喜多:Sony PCLの喜多です。今日は、SONY PCLで昨年の夏SONY銀座ビル用に作ったOPUSシアターの3DのコンテンツとTOSTEMさんのイベントがパシフィコ横浜であった時に制作した映像2本再生します。銀座Sonyビル用の物は、視差調整等が現在健康被害等を言われてる次元の前のものですので、かなり3D感を出しています。もし気持ち悪くなる方がいたら大変だなと思いまして、先に話しておきます。 では、Sonyビルの3Dアクアリウムを再生します。

[ 作品視聴 ]

昨年の夏休みに子供向けとしてSony銀座ビルの7階OPUSシアターという所で、期間限定で2週間程上映したものです。見ておわかりの通り、IMAGICAさんの3ality Digital撮影のものとはかなり手法も異なっています。映像はSony PCL独自の撮影リグを用いておりまして、横長いシアター向けを意識して、わざと視差を大きくつけてあります。サウンドトラックは、完全に5.1chのポストプロダクションでMIXしました。次はTOSTEMさんのエコ博というのが9月の中旬にありまして、そのイベント用映像です。ドラマ仕立てでかなり楽しめこういうコマーシャルがあってもおもしろいんじゃないかと私は思っています。

では、TOSTEMインプラスマンを再生します。

[ 作品視聴 ]

村越:それでは、Q&Aに移りたいと思います。

Q:喜多さんの作品は、音の高さや厚さがあるのはシステムが違うからでしょうか?2作品とも高さも奥行き感も全然違うと感じました。

A:美海水族館に関しては、本来、作曲の方と直接ポストプロダクションで5.1chで音楽を作ろうというアプローチだったので、我々ポストプロダクションのエンジニアが音楽のミックスダウンをしてもいいのだろうかというところも疑問に思いながらも、お互いで相談していくという形でやりましたので、音像は意外とふっていたりするのですね。

Q:映画館で聞いてるみたいな感じがしました。

A:ありがとうございます。インプラズマンに関しては劇場というものがパシフィコ横浜の中で組まれたので、その場所がどういう環境なのかということを一応確認し実は布一枚で覆ってあるようなところで、外の音が以外と入り込んでくる環境なので、なるべくセリフなどがちゃんと聞こえるようにMIXしました。アプローチとしては、Sony PCL405というスタジオでプリミックスでパンニングは全部やってしまいました。

Q:音ではなく、3D映像の制作に携わっている佐々木さんにお聞きしたいのですが、3Dの映像として2種類あると思います。ひとつはスクリーンは正面に限って3D映像を出すというパターンともうひとつは2Dなのだけれど、全周囲、ドーム型の映像で全方向に画があるパターンと、2種類が方向性としてあると思うのですが、どちらのほうが、それぞれのメリット、デメリットも考えて見ている人に対して有効的とお考えですか?

A:たしかにそうですね。巨大なドーム型映像の立体館と今流行っているメガネかけて見る2眼方式の3Dということですね。どちらにも良いところがあって、どちらにも少し苦手なところもあるのですが、今流行っているのはやっぱりメガネをかけてLRそれぞれ違う映像を見て立体感を感じるという方が、リアルさというか、生々しさというものがあると思います。臨場感的には人間は常に右左違う映像を見て生活をして、立体感を感じているので、それに近いところの臨場感というものは得られると思います。

Q:正面だけに3Dすると画が見切れてしまいますよね。凄い大きなスクリーンを前面に用意すれば良いのですが、そのデメリットとそれが無い2Dのものを音に照らし合わせて考えると今の3Dというのはいわゆるバイノーラルで立体音響を作っているようなものなので、「左の音に左の音、右の耳に右の音」そのパターンと2Dなんだけれど、全方向スピーカーを用意してという、これがサラウンドの音響だと思うので、今、なんとなく映像はバイノーラルで音はサラウンドで、という違う方式でお互いやっているような感じなので、映像の方からすると、どっちのほうが臨場感だとか考えをお持ちなのかなと思ってお聞きしました。最終的には全方向に3Dというウェイブシンセシスではないですけれど、音でいうと、そういう方向が一番なのですけれど、なかなか今はまだ、未来の話なのかもしれません。

A:会場によっては3Dのスクリーンをマルチ画面で何画面も立体的に横に並べてみる3Dとか、そういうのも展示会とかでやられているものもあって、そういう時は臨場感は格別なものがありますね。

Q:さきほどの3Dのメガネのシステムのところで144Hzという話をされたのですが、24pと60iの同期の関係がどうなっているのですか?

A:24pのときは144Hzでトリプルフラッシュという、1秒間に144コマで左72コマ右72コマ。60iのときにおそらく96pです。なので、厳密にはこの部屋で最適に見ようとすると24Pで見るのが最も最適な視聴方法ではあるのですが、放送をターゲットに作られたコンテンツということもあって、60iの素材しかなかったということです。今回は60iの素材も24pに最適な環境で上映を行いました。

Q:そこのズレというか、144Hz、72Hzと24pというのは倍数の関係にあるということでしょうか?

A:そういうことですね。なのでそれが最適ということで、家庭用のテレビでは122Hzまたは244Hzということで放送のコンテンツに関しては最適に見られるようにTVが発売されているということですね。

Q:村越さんにお尋ねします。最初のピアノと弦楽五重奏なのですが、録音時のモニターはどのような方法ですか?

A:モニターは、ヘッドフォンで聞いています、基本的にはVTRに送るダウンミックスを聞いたり、後はいわゆるDigi003をお使いになった方は分かると思うのですが、ヘッドフォン端子にAUXで音を選んで送っておいて、各チャンネルをソロで聞いて見たりだとか、両サイドのものを聞いてみたりだとか、チェロを聞いて見たりしています。ピアノのほうは元々はONマイクが2つ立ててありましたので、それをLRで聞いたり、サラウンド側のマイクを通して聞いたり等はしていますが、空間の確認は録っているときにとれていません。

Q:喜多さんと村越さんに質問なのですが、ミキシングをするときに、通常は2Dの画を見てミキシングをされることが多いと思うのですが、やはり3Dを見ながらミックスしたほうがいいかなと思うときがありますか? もうひとつは、3Dというのはもちろん昔から、私もSonyにいたころからいろいろとやらさせて頂いたのですが、はるかに違うのは、前に飛び出すということではなく、奥行き感だと思うのですが、こういった状況の3Dが登場したことによって、果たしてこのままの5.1chなどの音響システムで実際にそれが表現できるかと言う点です。

A:3Dの仕事のときは、だいたい編集室で一回、MA前に映像をなるべく確認をできるようにしています。さすがに今の現状のMA室では3D映像を見ながらMAをするのは不可能なので、今後作業量とともに考えていかなくてはいけない課題なのかもしれませんが、メガネをかけたままコンソール見たときに気持ち悪くならないだろうかどうかなどその辺の問題が作業環境にどう影響を及ぼすのかまでは今のところ研究をしておりません。それから2番目の質問に関してですが、「ひっこむ音はサラウンドにとって苦手ですよね」という話をよくしていまして、私が最近、実験したのですが、ハードCの後ろ側、1mぐらい後ろに遠いC勝手にFCと名前をつけてやってみたのですが、パンフォーマットがコンソールに無かったので、LCRSのパンフォーマットを借りて、Sチャンネルを遠いハードCのような扱いで、フロントの「ツラ」と「遠い」というのを試したら、はるかにEQとかリバーブとかレベルとかでいじるよりも、遠くに行くのですね。ONの小さい音は近い。小さいだけで。遠くにどうやってもならないというのをずっと思っていて、ひっこむサラウンドはどうすれば良いのだろうかということを個人的には実験していますが、そんなフォーマットはないので、LCRの後ろにもうひとつLCRを立てたかったのですが、そこまで物理的に用意ができなかったというのもありまして、変則的な三角形というものはやったのですが、やっぱり遠くに逃げるのですね。体感上。これはちょっと良いなと思っているのですが、どこにもフォーマットがないので、今後どうするのだろうということは思っています。

A:非常に難しい質問を頂いたなと個人的には思っています。まずひとつ目の質問は3Dを見ながらですよね。それはスケジューリングと打ち合わせとの兼ね合いによって大きく左右されるものが大きいので、私の場合は、終わってから必ず確認をするということをやります。もう一点は打ち合わせを密にさせて頂くことをなるべくするようにしています。ただし、美海水族館のように、音源ソースが非常に少ないものに関しては、音楽の作家の方であるだとか、そういったところの打ち合わせでとどまってしまうことが多いですね。仕上がった映像を見る機会というのは現場のOPUSシアターに行っての調整が最終段階だったりするので、基本的にはやっぱり2Dの環境のところできっちり作れる事が一番良いと思っています。まずサラウンドとしてきちんと作品を壊さないものがちゃんと作られているかということが第一前提だと思っています。コンテンツとサウンドトラックのマッチングについては、奥行きのレイヤーというのを音場層で作るべきかどうかというのを議論したことがあるのですが、ケンカの寸前まで話し合ったことがあるのですが(笑い)、「スピーカーが物理的に置けない」ということもあるので、私は村越さんとは違うアプローチでリバーブを使ったりEQ処理だったりとかで奥行き感はどうやったら作れるかな、という実験はしているのですが、村越さんほど体感できるところまで、「これだ」という方向はまだ発見できていないですね。確かにフォーマットも含め今後は、今年のAESでも言われていたような、縦方向の空間を優先させるべきなのか奥行きなのかというところが悩ましいところだと思っています。

Q:今の話の続きになるのかもしれないのですが、最後のコンテンツは、LCRの画面に映っている奥行き感の音像と、音楽と効果音のサラウンド感というのはわりと分離ができているように感じています。フロントのLRにあまり音楽がいなくて、ワイドにいる感じのミックスを感じたのですが、それは意図的にされているのですか?

A:実はあれはコンテンツとして映画館仕様では作っていないので、後ろを85dBでやっているのですね。今回は3dB上げてもらいました。そしたら音量が大きかったというのもあって、かなりそういう感覚は錯覚されたかなと思ったのですが、実はちゃんとフロントにもいます。音楽に関しては実は2チャンネルです。予算の都合で、監督が持っている音源ライブラリから、今は監督が音源ライブラリを持つ時代なんだなとすごく驚いているんですけれども(笑い)、そこから持ってきた編集済みの音楽をさらにトリートメントしてきれいに編集点を作って(5.1chに)アップミックスする手法で、いちおうリアは作っておいた方が包まれ感は出るし、もし良くなかったらやめようということで、あと効果音がスピーカーの外側までいくようなパンニングをしてあげると出やすいのかなとは思っています。セリフはわりときれいに録られていたのでそういう音のソースカテゴリごとのレイヤー構造みたいなものは出来たと思っています。

Q:ピアノソロの作品で、画面左に鍵盤が並んだ時にその角度に音が定位していたように感じたのですが、何か特別な処理をされたのですか?

A:ピアノを録音する時に、ピアノの反射板が客席に向けて置くと音が良いという教会の方のアドバイスがあり、オンマイクを通常の発想で立てるとサラウンドマイクとどうやって整合性をとったらいいのかと悩んでいる間に、録りますと言われて、そのままいわゆる一般的なステレオ録音のハンマーに近いオンマイクで立てました。それだけでもステレオで成立するように録ってそれにアドオンする形でサラウンドツリーの音をのせる方法しか無いと思っていたところもありました。それで結果論ですが意外とマッチングが良かった。その効果を出しているのが、サラウンドツリーの5本を1組として、ステレオオンマイクのレベルを決めたあとに(サラウンドツリーの音を)足したり引いたりフェーダーをいじっていたら「ここが気持ちいい」というところがあったのでそこに落とし込んでいます。全体に聴いて変なディレイ感や位相感が出ないことは確認して。今回は5.1ではなく5.0でやるということだったので低域に関しても過不足無くおかしなことにならないようにというところだけ注意して、それにほんの少しだけリバーブがのっているだけです。

Q:サラウンドツリーの2.7mの高さが忠実に出ていると思うのですが、その高さは色々試してみて決めたのですか?

A:そうです。テスト録音の時に3名で行ったのですが、計算では3m強の高さにしようと思って行ったんですが、LCRをステレオに畳み込んでモニターしたときにちょっとオフっぽいかなと感じて、リアのLRだけを聴いた時にオフすぎるという印象を、無指向性のわりにこんなにオフでいいのかなと思ったので前後位置も高さも変えました。それは録りながら上げて、下げてといわゆる撮影の時に照明さんがやるようなアナログチックにやりました。想定した場所からはちょっとずれましたがやはり現場で調整するのがいいのかなと思います。

Q:それはDigi003のヘッドフォンアウトで聴いてということですね?

A:そうです。それは5チャンネル分をテレビ方式のダウンミックスにかけて聴いていて、それと、オンマイクの2本を足したり足さなかったりして空間を頭の中で想定しているというか、オンオフの感じはなんとなくわかるのであとは全体の空間の感じをスタジオで作れば良いかなということと、もし空間が足りないようであれば、MAというかミックスの時にリアチャンネルだけディレイするのもありかなと考えてもいましたが試した結果それはやっていません。

Q:せっかくなのでカメラの方に質問です。3Dで撮影する時に、クレーンなどの特機というのは現状あるものをそのまま使えるのですか?

A:リグを使って撮影すると、カメラ自体が大きくなるので、IMAGICAのリグですと軽いもので30kg、重たくなると5、60kgかかってくるのでクレーンのアームの耐久加重に耐えれるもの、あとはクレーンのヘッド部分に収まりきるかどうかをクリアすれば現状のものでいけます。やはり3Dは撮影しながら動きがあるとすごい立体感が出てくるので特機とセットで撮影するということがすごく多いです。

Q:ということは3Dのカメラのセットは今後小さいものになればなるほどカメラマンとしては嬉しい?

A:できればそうですね。ただ現状のリグと使うレンズにもよるのですがやはりワイドめで撮りたいとなるとリグがどんどん大きくなってきたりするので、その辺は今後に期待というか小さくなれば機動性は上がります。

Q:カメラの視野の広い狭いという調整の方法は3Dの方式によって違うのですか?

A:方式によっては変わらないです。例えば収録は右目左目のLRをそれぞれフルHDの状態で撮って、そのあと劇場で色々違う方式に変えるのは一旦マスターを作ればそこから変換するだけなのでそこは問題ないです。

Q:ではカメラマンとしては、上映の方式とか記録の方式とか関係なしに一定のもので撮っておけばいいのでしょうか?

A:特殊な環境、例えば上映する劇場や設備が決まっている場合などはそこ用に、例えばメガネをかけて暗くなるから少し明るめに撮っておこうなどはあるかもしれませんが基本的には一般的な方式で作って各劇場に渡すというだけです。プロジェクターとメガネによって、今かけているXpanDやRealD、DolbyDなど各方式で微妙な明るさの変化があり、劇場の違いにもよってくるので難しいところなんですけれども、それは再生側の調整の話ですね。

Q:我々は音のサイドなので、ステレオで表現する音場とサラウンドで表現する音場に大きな違いと楽しみを見つけているんですが、カメラマンの方は従来の2Dでやるのと今回のように3Dでの撮影を経験されたのとでどんな感想をお持ちなんでしょうか?

A:3Dは今までの2Dと映像の演出方法が変わってくるところがあります。例えば2Dの音楽ものやライブものだとカット割りがすごい短く短くやっているのを、3Dで同じように短くしてしまうと立体感を目で確認して感じるまでに人間にディレイがあるので、出来る限り短いカット割りはせずに長く回してつないでいくやり方のほうが3Dとしては見やすくて面白かったりするようです。3D映像としての見せ方というか演出方法は研究されているところなんですが、今後は変わってくると思います。

Q:カメラで撮られている時は3Dの映像を見られているのですか?

A:今のIMAGICAの方式だと片面のRchのカメラの2Dのビューファインダーで確認しながらやっています。

Q:それを頭の中で3Dに合成しながらでしょうか?

A:そうです。また3Dは3Dで別個にコントロールする人がVEのような形で調節していますので。現状はそういうやり方になっています。

喜多:Sony PCLの場合は、クライアントモニターには仮合成した3Dのパネルを見ています。ただし小さいものです。

Q:視差というのは個人差がありますか?

A:あります。3D映像は個人差がものすごく大きいです。強烈な視差をつけた映像に関してもものずごい立体的に見える方もいればそんなに立体的に見えない方も全然立体感を感じない方もいて本当にバラバラです。そこに関して作り方としては今は最小公約数といいますか、誰もが自然にあまり行き過ぎない3Dをつくるような設計をするのが主流です。

Q:映画館の座る場所によって、見え方が変わったりすることはあるのですか?

A:劇場によって座る場所によっても立体感は変わってきます。やはり人間の目の幅とスクリーンの視差の相対関係が座る距離によって変わってくるので、後ろに座れば座るほど立体感は強調して見えます。飛び出しや奥行きも、スクリーンは相対的に小さく見えてしまいますが、強く感じるようになります。

Q:音声だとスクリーンから2/3の位置を中心と考えてミックスするなどありますが、映像にはそういった基準のようなものはありますか?

A:出来る限りスクリーンの正面で見た方が設計者の意図は忠実に再現される形になります。3Dを見ながら頭を動かすと欠像する部分が変わってくるので背景がぐわっと動くようになるのでそういう意味でも正面から見て頂くのがベストです。

参加者:3DでもIMAXの3Dなどドームシアターの本格的な3Dで見ると視野がすべて覆われているので没入感は最高に良いと思います。ただ2Dでも視野が覆われていると没入感は,良いと思います。

参加者:今の3D映像は,音の世界でいうとバーチャルサラウンドと一緒で2つのスピーカーで信号処理して左の音は左耳だけ右の音は右耳だけという方式に近いなと思うのですが、音の方では、現在全方向2Dのサラウンドに移行していったので、映像はどうなるのかなというのは大変興味があります。

沢口:みなさんどうもありがとうございました。今回は、すばらしい映像/音響の3Dを体感していただきました。会場を提供していただき多くの3D映像を用意していただきましたIMAGICA/SONYPCLのみなさんにあらためて感謝いたします。(一同拍手)

[ 関連リンク ]

株式会社IMAGICA:3D関連サービス・技術情報

3ality Digital:TS-2 Studio Beamsplitter Rig

ソニーPCL株式会社:3D/4K

「サラウンド寺子屋報告」 Index にもどる

「サラウンド入門」は実践的な解説書です

No comments:

Post a Comment